شرکت OpenAI رسماً اعلام کرده که در حال آزمایش نمایش تبلیغ برای کاربران نسخههای رایگان چتجیپیتی (نسخههای Free و Go) در آمریکاست. با اینکه بیانیه رسمی OpenAI جوری نوشته شده که با کلماتی مثل «حفظ حریم شخصی» و «انتخاب کاربر» موضوع را تلطیف میکند، اما با نگاهی دقیقتر به کارکرد این تبلیغات متوجه میشویم که دغدغههای عمیقی راجع به امنیت دادهها و آیندهی حریم خصوصی در هوش مصنوعی به وجود میآورد.

در ادامه ابعاد مختلف این تصمیم جدید سازندگان چتجیپیتی را بررسی میکنیم.

۱. دادههای شما، کالای اصلی معامله

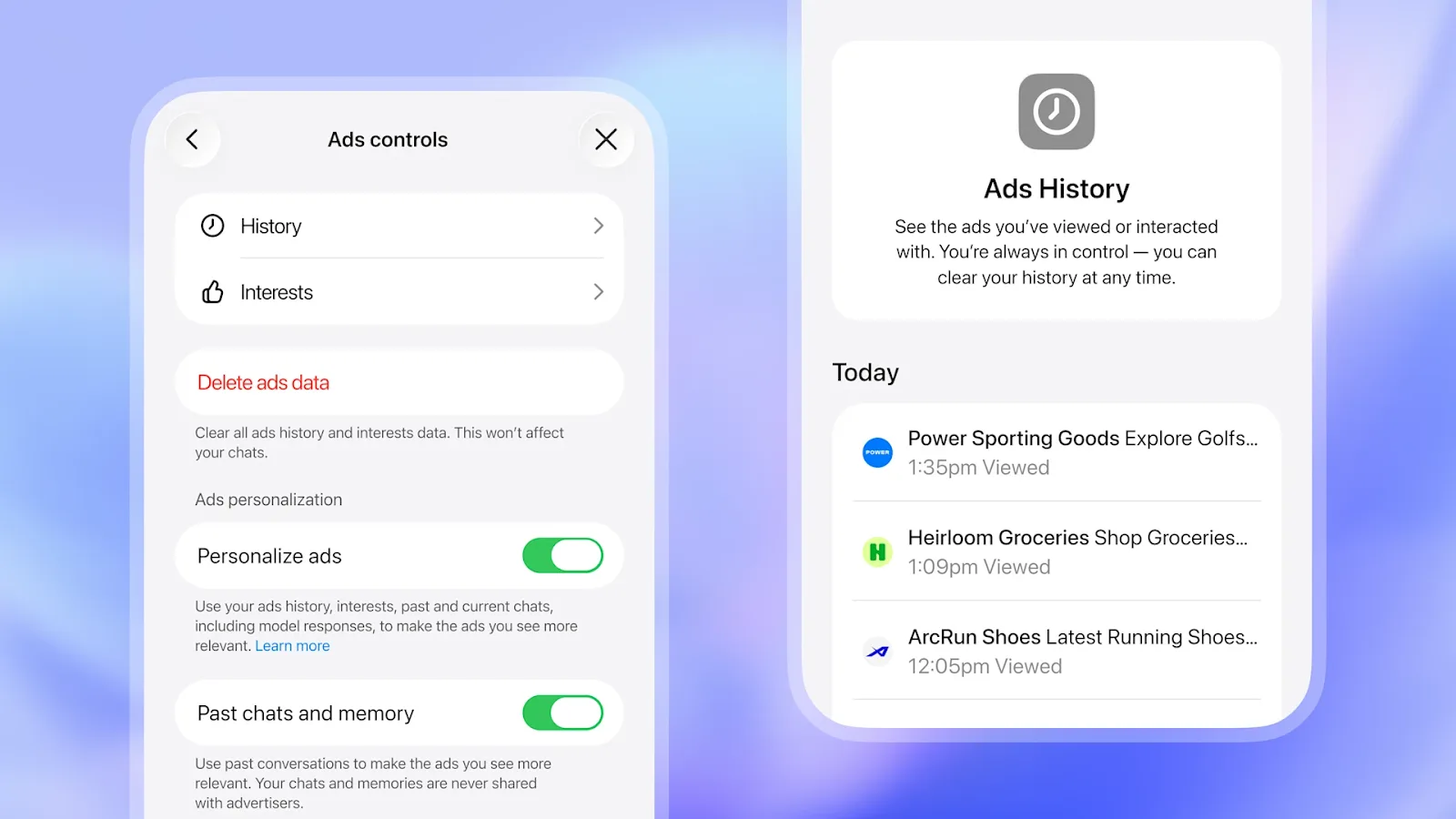

شرکت OpenAI صراحتاً اعلام کرده که برای نمایش تبلیغات از «موضوع مکالمه فعلی»، «چتهای گذشته» و «تعاملات قبلی شما با آگهیها» استفاده میکند.

تا دیروز، هوش مصنوعی درخواستهای شما را میخواند تا یا پاسختان را بدهد و یا تعلیم ببیند. اما از امروز به بعد، چتهای شما (حتی چتهای قدیمی و خصوصی) را اسکن میکند تا برای شما یک «پروفایلِ مصرفکننده» بسازد.

اگرچه OpenAI میگوید فعلاً در گفتگوهای حساس (مثل سلامت و سیاست) تبلیغ نشان نمیدهد، اما الگوریتمهای آن همچنان در حال پردازش دقیق علایق، شغل و دغدغههای روزمره خواهند بود تا خوراک لازم برای موتور تبلیغاتی را تامین کنند.

۲. یک معامله اجباری: یا اطلاعات بدهید یا محدود شوید!

در این طرح جدید، کاربران نسخههای پولی (Plus و Enterprise) از نمایش تبلیغات مصون میمانند؛ اما کاربران نسخههای رایگان در یک دوراهی عجیب و بیسابقه قرار گرفتهاند:

- یا به شکل عادی از ChatGPT استفاده میکنید و در ازای استفاده خود آگهی میبینید.

- یا نمایش تبلیغات را در تنظیمات غیرفعال میکنید و در مقابل، تعداد پیامهای روزانه محدود میشوند.

این یعنی OpenAI رسماً اعتراف کرده که دادهی خصوصی شما، نوعی ارز قابل تبادل برای پرداخت هزینههای سرویس است!

اگر حاضر نباشید اطلاعات و ذهنتان را در اختیار تبلیغدهندگان بگذارید، سرویس محدودتری دریافت میکنید. این رویکرد، حریم خصوصی را عملاً به «کالای لوکس» تبدیل میکند:

امنیت برای آنها که پول میپردازند و نظارت همگانی برای بقیه!

۳. سراب امنیت

سازندگان ChatGPT ادعا میکنند که تبلیغدهندگان به چتهای شما دسترسی ندارند و فقط آمارهای کلی (مثل تعداد کلیکها) را میبینند؛ اما در دنیای تبلیغات، لازم نیست شرکت واسط، داده خام را مستقیم به تبلیغدهنده بدهد تا حریم خصوصی کاربران نقض شود. همین که ChatGPT خودش دادهها را پردازش میکند و ما را در دستهبندیهای خاص (مثلاً دارای مشکلات روحی) میگذارد تا تبلیغ هدفمند نمایش دهد، یعنی حریم خصوصیِ ذهن ما نقض شده.

هوش مصنوعی که قرار بود دستیاری بیطرف باشد، حالا انگیزههای مالی دارد و ما را به خرید سرویسهای پولی سوق میدهد!

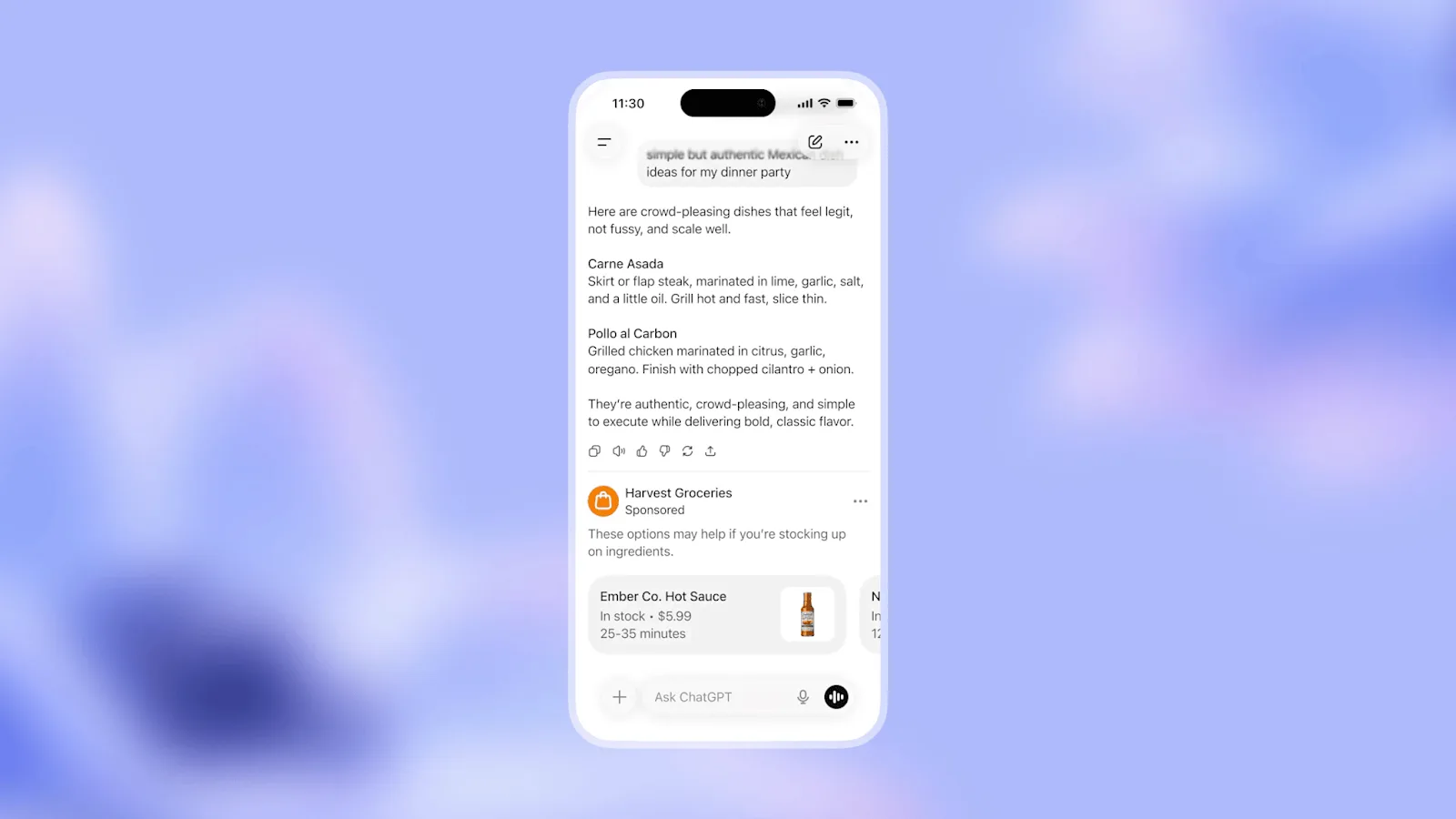

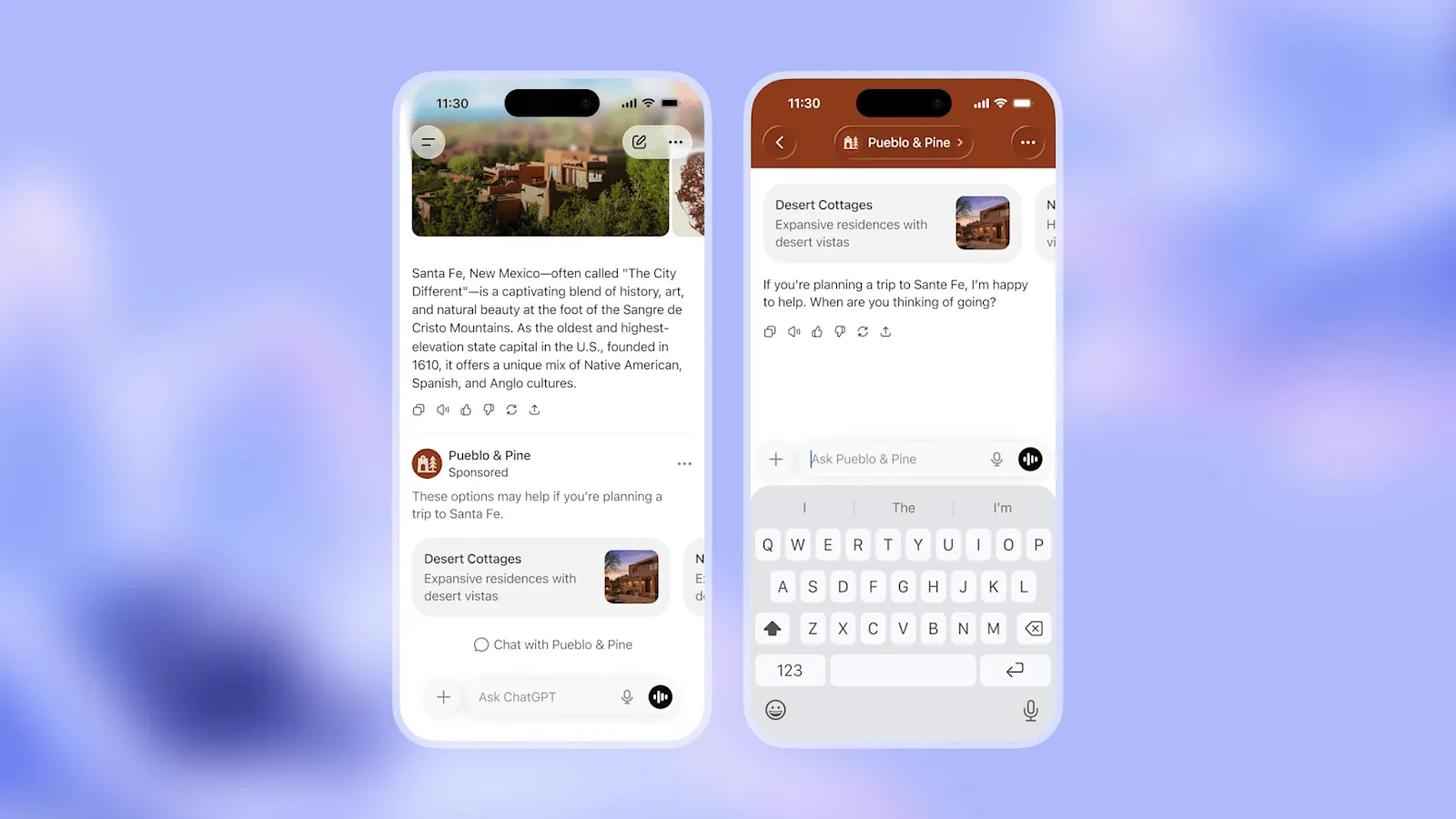

۴. دستکاری شناختی: وقتی دستیار به فروشنده تبدیل میشود!

خطرناکترین بخش ماجرا، ترکیب «قدرت متقاعدسازی هوش مصنوعی» با «اهداف تجاری» است. ChatGPT یک موتور پاسخدهی ساده نیست؛ همصحبت و همدمی است که خیلیها مثل اعضای خانواده خود به آن اعتماد دارند. وقتی این همصحبت شروع به نمایش تبلیغات براساس نقاط ضعف یا نیازهای فوری (که از گفتگوها استخراج شدهاند) میکند، مرز بین «کمکرسانی» و «سوء استفاده تبلیغاتی» بسیار باریک میشود.

متخصصان امنیت این پدیده را نوعی «مهندسی اجتماعی در مقیاس انبوه» میدانند که میتواند به شکل ناخودآگاه به تصمیمات کاربران جهت دهد.

۵. تکرار تاریخ: مسیر گوگل و فیسبوک

آنچه امروز در ChatGPT میبینیم، برای کاربران قدیمیتر اینترنت کاملاً آشناست. شرکتهای بزرگ فناوری (یا به اصطلاح Big Tech) معمولاً با ارائه خدمات رایگان و با کیفیت شروع میکنند تا کاربران جذب شوند. پس از وابستگی کاربران، مدل درآمدی تغییر میکند و دادههای کاربران به ارزشمندترین دارایی شرکت تبدیل میشود. به نظر میرسد OpenAI هم که روزی با ادعای «غیرانتفاعی بودن» شروع به کار کرد، اکنون ناچار به پیروی از همان قوانین در بازار و «اقتصادِ توجه» شده است.

جمعبندی: هوشیارتر باشیم…

نمایش تبلیغات در ChatGPT لزوماً به معنی لو رفتن خصوصیترین اطلاعات شما (نام کامل و مشخصات) نیست، اما قطعاً به معنای پروفایلسازی دقیقتر از شخصیت شماست.

به عنوان یک کاربر آگاه، باید بدانیم که دوران طلایی استفادهی کاملاً رایگان و بیدغدغه از پیشرفتهترین هوش مصنوعی جهان به پایان رسیده. از این به بعد هر کلمهای که در چتباتهای رایگان تایپ میکنیم، نهتنها پردازش میشود، بلکه ارزش تجاری هم خواهد داشت. شاید واقعاً زمانش رسیده که در اشتراکگذاری اطلاعات حساس و شخصی با هوش مصنوعی، محتاطتر از هر زمان دیگر عمل کنیم.

۲ پاسخ

|

باتشکرازمدیریت محترم بحث بسیار جالب وواقعیتی قابل تامل میباشدکه ذهن کاربران راروشن مینماید, باسپاس

|

بسیار مفید و آگاهی بخش، خیلی ممنون از شما و تیم خوبتون بابت زحمت هایی که می کشید.