تا حالا پیش آمده که سیستم اتوماسیون یا نرمافزار شرکت آنقدر کُند و اعصابخردکن باشد که ترجیح دهید فایلتان را در یک سایت هوش مصنوعی رایگان آپلود کنید تا کارتان سریعتر راه بیفتد؟ شما در این تجربه تنها نیستید! با وجود سرمایهگذاریهای چند ده یا حتی چند صد میلیاردی شرکتها روی هوش مصنوعی، بزرگترین تهدید امنیتی شبکهها، خود این فناوری نیست. دردسر اصلی، کارمندانی هستند که به دلیل ناکارآمدی برنامههای رسمی شرکت، پنهانی به سراغ ابزارهای تاییدنشده میروند.

این پدیدهی خطرناک که به آن هوش مصنوعی سایه (Shadow AI) میگویند، اطلاعات حساس سازمانها را بهراحتی لو میدهد. این یعنی بدون آموزش و نظارت بر کاربران، خرید گرانترین ابزارها هم چیزی جز دعوت به یک فاجعهی سایبری نیست.

ریشهی مشکل: درگیری با ابزارهای کُند و فرار به سوی میانبرها

آمارهای موسسهی والکمی (WalkMe)، یک شرکت فعال در حوزه بهبود تجربه استفاده از نرمافزارهای سازمانی، نشان میدهد که کارمندان در طول یک سال، چیزی حدود ۵۱ روز کاری خود را فقط به خاطر نرمافزارهای پیچیده و رابط کاربری ضعیف از دست میدهند. تصور کنید از هر سال کاری، تقریباً دو ماهِ کامل فقط به خاطر کلنجار رفتن با سیستمهای کُند هدر برود!

این مسیر غیررسمی همیشه به معنای «هککردن» یا شکستن مستقیم دیوارهای امنیتی نیست. در بسیاری از موارد، کارمند فقط دارد سیاستها و فرایندهای تایید سازمان را دور میزند؛ مثلاً متن یک ایمیل محرمانه را در یک چتبات عمومی کپی میکند، فایل شرکت را در یک سرویس ناشناس آپلود میکند یا از حساب شخصیاش برای انجام کاری استفاده میکند که باید در محیط رسمی و کنترلشدهی سازمان انجام میشد.

تولد هوش مصنوعی سایه و بحران حریم خصوصی

نبود آموزشهای لازم و یکپارچه نبودن برنامهها، دو دلیل اصلی برای شکست پروژههای امنیت سایبری هستند. وقتی شرکتها قانون مشخصی برای استفاده از هوش مصنوعی نداشته باشند، کارمندان خودشان دستبهکار میشوند. آنها برای اینکه کارشان زودتر تمام شود، نامههای محرمانه یا دادههای مالی شرکت را در سایتهای عمومی وارد میکنند؛ سایتهایی که هیچ کنترلی روی آنها وجود ندارد.

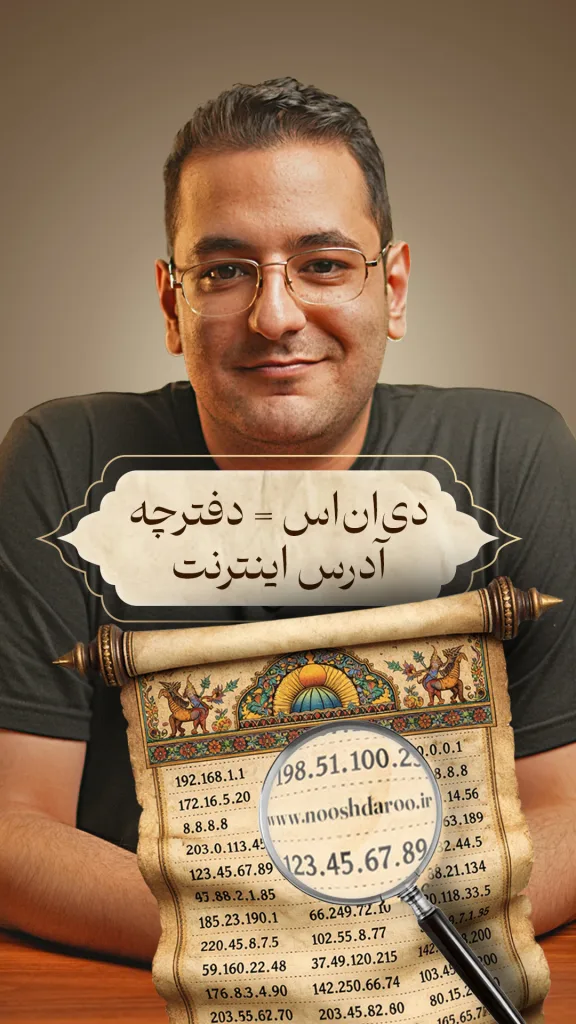

هوش مصنوعی سایه به معنای استفادهی پنهانی کارمندان از سرویسهای رایگان (مثل چتباتهای عمومی) بدون اطلاع تیم شبکهی سازمان است. این کار خیلی زود به افشای اطلاعات محرمانهی تجاری ختم میشود.

هوش مصنوعی سایه چرا خطرناک است؟

بزرگترین خطر Shadow AI این است که استفاده از آن معمولاً خارج از دید تیم امنیت و فناوری اطلاعات رخ میدهد. یعنی سازمان دقیقاً نمیداند چه دادهای، توسط چه کسی، در کدام ابزار هوش مصنوعی وارد شده و بعد چه بلایی سر آن آمده است. همین کاهش دید امنیتی، احتمال نشت اطلاعات، نقض محرمانگی، دردسرهای حقوقی، و حتی از دست رفتن مالکیت برخی داراییهای فکری را افزایش میدهد.

مشکل دیگر این است که بسیاری از کارکنان، از روی سوءنیت سراغ این ابزارها نمیروند؛ آنها فقط میخواهند کارشان سریعتر راه بیفتد. همین موضوع باعث میشود برخورد صرفاً تنبیهی هم معمولاً جواب ندهد. وقتی سازمان ابزار رسمی راحت، سریع و قابلاعتماد در اختیار نیروها نگذارد، طبیعی است که بخشی از کارکنان به میانبرهای بیرون از چارچوب پناه ببرند.

برای مهار هوش مصنوعی سایه چه باید کرد؟

راهحل این مشکل فقط ممنوعکردن ابزارها نیست. سازمانها باید اول از همه مشخص کنند چه ابزارهایی مجاز هستند، چه نوع دادههایی را میتوان وارد سرویسهای هوش مصنوعی کرد و چه چیزهایی مطلقاً نباید از محیط داخلی خارج شوند. در کنار آن، آموزشهای کوتاه و کاربردی برای کارکنان ضروری است؛ نه آموزشهای کلی و شعاری، بلکه راهنماهای روشن و عملی که دقیقاً بگویند در چه شرایطی چه کاری مجاز است و چه کاری خطرناک.

از طرف دیگر، اگر شرکت میخواهد کارمند از ابزار تاییدنشده استفاده نکند، باید جایگزین رسمیای در اختیارش بگذارد که واقعاً قابل استفاده باشد: سریع، ساده، در دسترس و هماهنگ با جریان واقعی کار.

سخن پایانی

هوش مصنوعی سایه فقط یک مسئلهی تکنولوژیک نیست؛ نشانهی شکافی عمیقتر میان نیاز واقعی کارکنان و ابزارهایی است که سازمان در اختیارشان گذاشته است. تا وقتی این شکاف پر نشود، حتی گرانترین سرمایهگذاریها هم نمیتوانند جلوی نشت داده و دور زدن سیاستهای امنیتی را بگیرند. در نهایت، امنیت واقعی زمانی شکل میگیرد که هم ابزارها قابل استفاده باشند، هم قواعد روشن باشند، و هم کارمند احساس نکند برای انجام یک کار ساده باید از سیستم رسمی فرار کند.