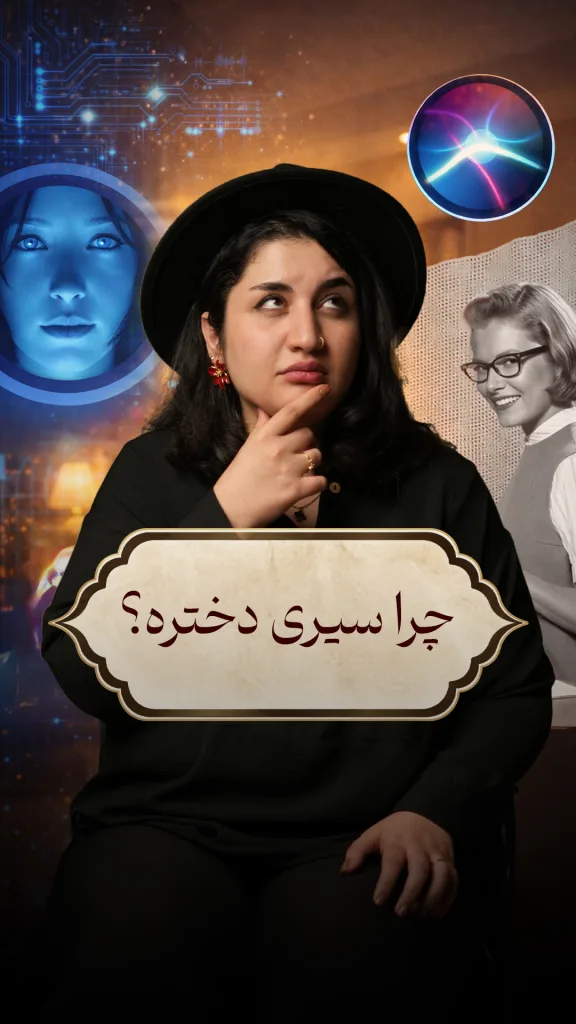

هنگامی که از دستیارهای صوتی مانند سیری، الکسا یا گوگل اسیستنت سؤالی میپرسید، به احتمال زیاد پاسخ را از زبان یک صدای زنانه میشنوید. شاید در نگاه اول این مسئله چندان عجیب یا قابلتوجه نباشد؛ آنقدر به شنیدن صدای زن در نقش دستیار دیجیتال عادت کردهایم که دیگر برایمان طبیعی شده است. اما اگر لحظهای مکث کنیم و دقیقتر به موضوع بیندیشیم، پرسش مهمی پیش میآید: چرا تقریباً همهی دستیاران دیجیتال و هوشهای مصنوعی صدایی زنانه دارند؟

این موضوع تصادفی نیست. بیش از یک دهه است که شرکتهای فناوری دستیاران دیجیتال خود، از سیری و گوگل اسیستنت گرفته تا کورتانا، الکسا، چت جیپیتی و حتی اسپیکرهای هوشمند را بهطور پیشفرض با صدای زن معرفی کردهاند. دلایل این انتخاب ریشه در تاریخ، روانشناسی و کلیشههای فرهنگی متعددی دارد که شاید کمتر به آن اندیشیده باشیم. در این مقاله از سری زنان و فناوری نوشدارو قصد داریم به بررسی ریشههای این کلیشههای بهظاهر بیضرر که به شکلگیری استانداردهایی خاموش در صنعت انجامیدهاند، بپردازیم.

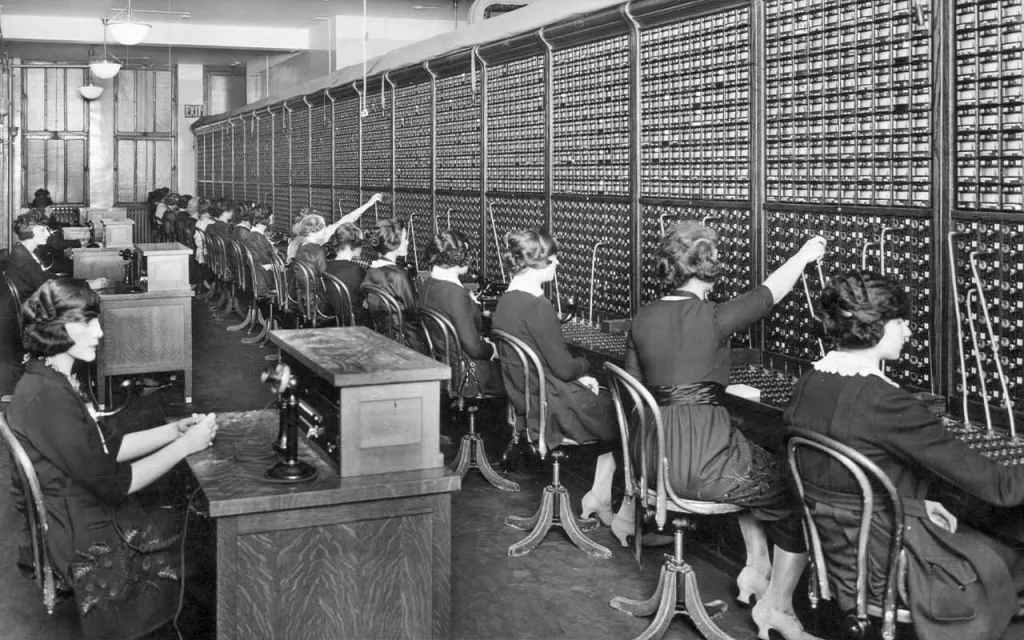

میراث اپراتورهای تلفن

شاید ریشهی این الگو را بتوان در قرن نوزدهم میلادی جستوجو کرد، زمانی که فناوری ارتباطات تازه در حال شکلگیری بود. الکساندر گراهام بل، مخترع تلفن، پس از مدتی دریافت که اپراتورهای اولیهی تلفن که همگی مرد بودند، در برخورد با کاربران رفتاری خشک و گاه بیادبانه دارند. این موضوع با رویکرد بل در ارتباط با تلفن، در تضاد بود. به همین دلیل او در سال ۱۸۷۸ در تغییری قابل توجه، ابتدا «اِما نات» (Emma Nutt) و سپس خواهرش را به عنوان نخستین اپراتورهای زن تلفن در مجوعهی بل استخدام کرد.

لحن مودب و آرامبخش اِما خیلی زود تبدیل به یک استاندارد قابل پیروی میان اپراتورهای تلفن بدل گشته و به الگویی برای استخدام اپراتورهای بعدی تبدیل شد. به همین ترتیب تقریباً تا دههی ۱۸۸۰ زنها جایگاه تمام اپراتورهای تلفن را از آن خود کردند و این نقش به نوعی به عنوان کار زنانه بازتعریف شد. این موضوع انتظارات عمومی را شکل داد. ذهنیت مردم نسبت به صدای زنانه بهعنوان صدایی آرام، صبور و خدمتکننده شکل گرفت؛ باوری که بعدها در طراحی دستیارهای دیجیتال و ابزارهای هوشمند نیز بازتاب پیدا کرد.

اما این تنها مورد نبود؛ در دهههای میانی قرن بیستم، با شکلگیری صنعت هوانوردی مدرن، خلبانان با چالشی اساسی روبهرو بودند. صدای بلند موتورهای جت باعث میشد شنیدن هشدارهای رادیویی دشوار باشد. بهمرور مهندسان دریافتند که صدای زنانه به دلیل داشتن فرکانس بالاتر (Pitch)، در میان نویز موتور هواپیما بهتر شنیده میشود. صدای مردان معمولاً در محدودهی ۸۵ تا ۱۸۰ هرتز قرار دارد، اما صدای زنان بین ۱۶۵ تا ۲۵۵ هرتز است که باعث میشد صدای زنان در برابر اصوات بم موتورهای هواپیما واضحتر و متمایزتر شنیده شود. خلبانان نیز سریعتر به این صدا واکنش نشان میدادند.

از همینجا، مفهوم عامیانه و جنسیتزدهی «Bitching Betty» در میان خلبانان شکل گرفت؛ صدای زنی غرغرو که به آنها هشدار میداد یا خطاهای احتمالی پرواز را یادآوری میکرد. اما این تصمیم صرفاً فنی نبود و پیامدهای فرهنگی نیز داشت. بهتدریج، صدای زنانه در فناوری با مفاهیمی چون یادآوری، هشدار و کمک گره خورد؛ دقیقا همان الگوی جنسیتی که بعدها در سیستمهای GPS دههی ۹۰ و دستیارهای دیجیتال مدرن ادامه یافت. حتی امروز نیز در هواپیماهای جنگندهی مدرن و شاتل فضایی از صدای زنانه برای هشدارهای صوتی استفاده میشود. به این ترتیب، انتخابی که در آغاز صرفاً تصمیمی از جنبهی آکوستیک و فنی بهنظر میرسید، به مرور به یک کُد فرهنگی بدل گردید.

سوگیری پنهانی پشت صدای دستیارهای دیجیتال

بیش از یک قرن بعد نیز میتوان اثر این پیشینهی تاریخی را دید. پژوهشهای متعدد نشان میدهد که عموم افراد صدای زنانه را برای دریافت کمک ترجیح میدهند. در یک مطالعه دانشگاه نورثوسترن، شرکتکنندگان خوانندگان زن اخبار را قابل اعتمادتر از مردان ارزیابی کردند، و در یک نظرسنجی از تحقیقات دانشگاه مدیل نورث وسترن درباره دستیارهای صوتی، ۶۴ درصد افراد، صدای پیشفرض کاملاً زنانه را برای اسپیکر هوشمندشان انتخاب کردند. همچنین در زمینه پزشکی نیز آزمایشی از دپارتمان روانشناسی دانشگاه کارولینای شمالی، نشان داد که مردم به صدای زنانه برای مشاوره سلامت اعتماد بیشتری دارند و آن را مهربانتر از صدای مرد میدانستند.

روانشناسان و جامعهشناسان این پدیده را «اثر زنها شگفتانگیزند» (Women-are-Wonderful) مینامند؛ این پدیده در واقع نوعی سوگیری ناخودآگاه است که زنان را موجوداتی مهربان، پرورشی و مراقب میبیند. بر اساس این پدیده اشخاص ویژگیهای مثبت بیشتری را به زنان در مقایسه با مردان نسبت میدهند. این سوگیری در واقع نوعی تایید بر نقشهای جنسیتی و سنتی زن در جامعه است و با قرار گرفتن زنها در جایگاه قدرت و رهبری در تضاد است.

این موضوع در انتخاب پیش فرضها برای دستیارهای صوتی نیز ملموس است. در گزارشی از مؤسسهی تحقیقاتی ماکروسافت (Microsoft Research)، وقتی از کاربران پرسیده میشود ترجیح میدهند صدای دستیار دیجیتالشان زنانه باشد یا مردانه، اکثریت قاطع کاربران، فارغ از جنسیتشان، صدای زنانه را انتخاب میکنند.

این نتیجه در ظاهر شاید به عنوان سلیقهی شخصی تعبیر شود، اما در واقع ریشه در الگوهای عمیق فرهنگی و جنسیتی دارد. نوع وظیفهای که به دستیار دیجیتال سپرده میشود، تاثیر مستقیمی بر برداشت جنسیتی کاربران دارد. زمانی که نقش دستیار بیشتر جنبهی خدمترسانی، کمک روزمره یا همراهی دارد، کاربران، صرفنظر از جنسیت، به طور طبیعی صدای زنانه را ترجیح میدهند، چراکه در ذهن بسیاری، صدای زنانه با مهربانی، صبر و رویکرد حمایتی پیوند خورده است. اما زمانی که نقش دستیار رنگ و بوی فنی، تخصصی یا اقتدارمحور پیدا میکند، ترجیح کاربران به سمت صدای مردانه متمایل میشود؛ چرا که صدای مردانه اغلب با اعتمادبهنفس، تسلط و قدرت تصمیمگیری در ناخودآگاه جمعی همراه است.

پیش فرضهایی که در طراحی محصول تاثیر گذارند

برداشتهای جنسیتی و پیشفرضهای ذهنی کاربران، بهوضوح در طراحی محصولات دیجیتال تأثیر میگذارند و حتی میتوانند جهت تصمیمهای کلیدی طراحی را تعیین کنند. این پیشفرضها اغلب بهصورت ناخودآگاه عمل میکنند و طراحان را به سمت انتخابهایی خاص سوق میدهند؛ برای مثال، در تعیین صدای پیشفرض دستیار دیجیتال یا در انتخاب لحن و نحوهی پاسخگویی سیستم. این اثرات به ویژه زمانی دیده میشود که محصول برای تعامل روزمره با کاربران طراحی شده باشد و هدف آن ایجاد حس همراهی، اعتماد و راحتی در تجربهی کاربری باشد.

در همان گزارش، ماکروسافت در توضیح انتخاب صدای زنانه برای کورتانا (Cortana) اشاره میکند که این تصمیم به هیچ عنوان تصادفی نبوده است؛ بلکه نتیجهی مطالعهی گستردهی کاربران و بازخوردهای واقعی آنان بوده است. در این گزارش ذکر میشود: «ما دریافتیم که کاربران، صدای زنانه را در تعاملهای روزمره دوستانهتر، قابلاعتمادتر و صمیمیتر میدانند. هدف ما این بود که کورتانا حسی از همراهی و کمک ایجاد کند، نه اقتدار و دستور.»

در مثالی دیگر، تیم طراحی آمازون دریافت که صدای زنانه در تعاملهای و پاسخ به درخواستهای کاربران حس همدلی و راحتی بیشتری ایجاد میکند. آمازون گزارش داد که کاربران به صدای زنانه اعتماد بیشتری دارند و آن را گرم و صمیمی میدانند، در حالی که صدای مردانه ممکن است رسمیتر و کمتر صمیمی به نظر برسد. این تجربه باعث شد که الکسا (Amazon Alexa) با صدای زنانه بهعنوان پیشفرض ارائه شود و کاربران ناخودآگاه به آن عادت کنند، حتی وقتی سیستم امکان تغییر صدا به صدای مردانه یا بیجنسیت را فراهم میکند. این انتخاب بازتابدهندهی اثر پیشفرضهای فرهنگی و روانشناختی بر طراحی فناوری است و نشان میدهد که چگونه تصورات اجتماعی درباره جنسیت میتوانند ویژگیهای اصلی یک محصول دیجیتال را شکل دهند.

همانطور که گفته شد، خلاف این مسئله نیز صادق است. کاربران اغلب از صدای مردانه بهتر پیروی میکنند. برای مثال در دههی ۹۰ میلادی، شرکت خودروسازی BMW از صدای زنانه در سیستم ناوبری خود استفاده کرد که منجر به نتایج جالبی شد. مشاهدات نشان داد که رانندگان مرد تمایل نداشتند از دستورات صدای زن پیروی کنند. استاد ارتباطات دانشگاه استنفورد، کلیفورد ناس (Clifford Nass)، توضیح میدهد که این واکنش ناشی از تصورات فرهنگی و اجتماعی درباره جنسیت است؛ در واقع انسانها نسبت به صداها نه فقط به لحاظ آکوستیک، بلکه از منظر نقشهای جنسیتی واکنش نشان میدهند. در نتیجه BMW مجبور شد صدای مردانه را جایگزین کنند، زیرا رانندگان به طور ناخودآگاه صدای زن را کمتر قابل اعتماد و اقتدار آن را کمتر میدانستند. این مسئله نشان میدهد که حتی در فناوریهای پیشرفتهی امروز، کلیشههای جنسیتی سنتی هنوز در لایههای ظریف تجربهی کاربری محصول حضور دارند؛ کلیشههایی که بر پایهی باورهای قدیمی دربارهی نقشهای اجتماعی زن و مرد شکل گرفتهاند.

البته همیشه این تصمیمها مستقیماً از پیشفرضهای ذهنی نشات نمیگرفتند. گاهی اوقات مانند مورد سیستم هشدار هواپیما به دلایل آکوستیک و یا فنی بود. در سال ۲۰۱۶، هنگامی که گوگل در آستانهی رونمایی از دستیار صوتی خود بود، تصمیم داشت هر دو گزینهی صدای زن و مرد را بهطور همزمان عرضه کند. با این حال، در جریان توسعه مشخص شد که سیستمهای آموزش داده در پردازش صدای زنان عملکرد بسیار دقیقتری دارند.

برنت وارد (Brant Ward)، مدیر جهانی مهندسی گفتار گوگل، بعدها توضیح داد که الگوریتمها مرزهای آغاز و پایان آواها را در صدای زنان بهتر تشخیص میدادند، زیرا دادههای آموزشی صوتی آنها عمدتاً از صدای زنان تشکیل شده بود. غلبهی تاریخی زنان در مشاغل صوتمحور مانند اپراتوری تلفن، تأثیر مستقیمی بر توسعهی فناوریهای گفتاری داشت. این سابقه، مجموعهای گسترده از آرشیوهای صوتی زنانه ایجاد کرد که بهعنوان دادههای آموزشی در سیستمهای تبدیل متن به گفتار (TTS) به کار رفتند. در نتیجه کیفیت و تنوع دادههای صوتی زنانه بهمراتب بیشتر از دادههای صوتی مردانه بود، و همین امر باعث شد الگوریتمها در بازتولید صدای زنان عملکرد بهتری داشته باشند. در مقابل، تولید صدای مردانه با کیفیتی مشابه هزینهی زمانی بیشتری برای توسعه نیاز داشت. در نتیجه گوگل تصمیم گرفت دستیار صوتی خود را در نسخهی اولیه تنها با صدای زن عرضه کند.

البته از جهت دیگری نیز میتوان به مسئله طراحی محصول نیز نگاه کرد. صنعت فناوری نقطههای کور بسیار زیادی دارد. همانطور که در یادداشت دیگر تحت عنوان «فرهنگ برادری (Brogrammers) در فناوری» اشاره شد، عدم توازن جنسیتی در تکنولوژی غالباً جهتگیریهای مردسالارانه را در توسعهی محصول تکرار میکند. این تصمیمات طراحی، بازتاب مستقیم کمبود زنان در صنعت هوش مصنوعی است. تنها ۱۲ درصد از پژوهشگران یادگیری ماشین و حدود ۲۶ درصد از شاغلان حوزهی داده و AI در جهان زن هستند. در نتیجه تیمهای توسعه غالباً مردانهاند و سوگیریهای ناخودآگاه خود را در محصولاتشان بازتولید میکنند.

هنجارهای نویی که در حال ساختن آنها هستیم

چرا صدای دستیارهای هوشمند معمولاً زنانه است؟

با وجود اینکه بهنظر میرسد، اغلب انتخاب صدای زنانه برای این دست از دستیارها، در پاسخ به تقاضای بازار و یا پیچیدگیهای فنی کمتر است، اما ادامهی چنین رویکردی میتواند پیامدهای فرهنگی قابل توجهی داشته باشد. بسیاری از منتقدان معتقدند این انتخاب میتواند به صورت ناخواسته کلیشههای قدیمی دربارهی نقش زنان را بازتولید کند. این امر خطر آن را دارد که مردم، نقش زنان را بهطور ناخودآگاه با فرمانپذیری و خدمتگزاری پیوند دهند. یا آنطور که در گزارش «I’d blush if I could» یونسکو آمده است، این طراحیها اغلب نگرش پنهانی را تقویت میکنند که زنان برای برآوردن نیازهای دیگران ساخته شدهاند.

در این سند یونسکو ذکر شده که این سوگیری فرهنگی حتی در رفتار کاربران نیز منعکس شده است. کاربران هنگام تعامل با دستیارهای صوتی، گاهاً از زبان توهینآمیز یا جنسی استفاده میکنند؛ رفتاری که در برابر سایر ابزارهای دیجیتال بروز نمیدهد. این دستیارها نیز معمولاً با پاسخهای مؤدبانه و منفعلانهای چون عذرخواهی، سکوت و یا حتی تشکر واکنش نشان میدهند. چنین طراحیهایی ناخواسته این پیام را منتقل میکنند که شخصیتهای زنانه حتی در برابر بیاحترامی نباید مقاومت کنند. تکرار چنین الگوهایی میتواند باعث شکلگیری پیوند ناخودآگاه میان مفهوم زن و دستیار مطیع در ذهن کاربران شود و به مرور، نگرش اجتماعی نسبت به زنان واقعی را نیز تحت تاثیر قرار دهد.

بازنویسی آینده

با وجود ریشهدار بودن مسئله زنانه بودن صدای دستیارهای دیجیتال و روند رو به رشد ابزارهای هوشمند صوتی، اصلاح این موضوع در حال پیگیری توسط شرکتهای بزرگ فناوری است. امروزه صدای زن دیگر پیشفرض نیست و کاربران هنگام راهاندازی دستگاه میتوانند جنسیت صدا را خود انتخاب کنند. علاوه بر این، دستیارهای دیجیتال اکنون باید در برابر توهینها و زبان جنسیتزده واکنش قاطع نشان دهند. افزایش حضور زنان و اقلیتهای جنسیتی در تیمهای طراحی و مهندسی نیز برای شناسایی و حذف سوگیریهای ناخودآگاه ضروری است و بیش از پیش مورد توجه قرار گرفته شده است. از منظر فنی، توسعه فناوریهای نوین مانند صداهای خنثی و الگوریتمهای پیشرفته تولید گفتار، محدودیتهای گذشته را کاهش داده و امکانات بیشتری برای تنوع صداها فراهم کرده است.

در نهایت، زنانه بودن صدای دستیارهای دیجیتال تنها یک انتخاب زیباشناختی نیست، بلکه نتیجه دههها داده تاریخی، محدودیت فنی و کمبود تنوع انسانی در صنعت فناوری است. این وضعیت، تصویری ناعادلانه از زن ایجاد کرده؛ تصویری که در تضاد با برابری و واقعیت انسانی قرار دارد. امروز، شرکتهای فناوری مسؤلیتی اخلاقی بر دوش دارند. این شرکتها نه تنها باید از بازتولید تبعیض پرهیز کنند، بلکه فعالانه برای از میان بردن آن بکوشند. با حذف این پیشفرضهای جنسیتی میتوان آیندهای ساخت که در آن فناوری نه بازتاب تبعیضهای تاریخی، بلکه ابزاری برای ساخت جهانی برابرتر و انسانیتر باشد.